目录

目录JAVA全系列 教程

3762个小节阅读:7088.3k

目录

C语言快速入门

JAVA全系列 教程

面向对象的程序设计语言

Python全系列 教程

Python3.x版本,未来主流的版本

人工智能 教程

顺势而为,AI创新未来

大厂算法 教程

算法,程序员自我提升必经之路

C++ 教程

一门通用计算机编程语言

微服务 教程

目前业界流行的框架组合

web前端全系列 教程

通向WEB技术世界的钥匙

大数据全系列 教程

站在云端操控万千数据

AIGC全能工具班

A A

White Night

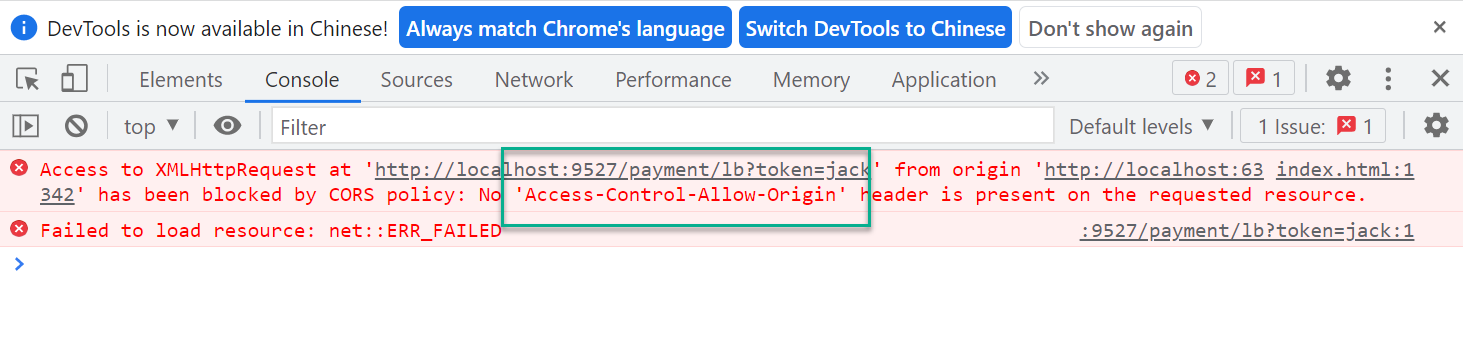

出于浏览器的同源策略限制。同源策略是一种约定,它是浏览器最核心也最基本的安全功能,如果缺少了同源策略,则浏览器的正常功能可能都会受到影响。可以说Web是构建在同源策略基础之上的,浏览器只是针对同源策略的一种实现。

当一个请求url的协议、域名、端口三者之间任意一个与当前页面url不同即为跨域

| 当前页面url | 被请求页面url | 是否跨域 | 原因 |

|---|---|---|---|

| http://www.test.com/ | http://www.test.com/index.html | 否 | 同源(协议、域名、端口号相同) |

| http://www.test.com/ | https://www.test.com/index.html | 跨域 | 协议不同(http/https) |

| http://www.test.com/ | http://www.baidu.com/ | 跨域 | 主域名不同(test/baidu) |

| http://www.test.com/ | http://blog.test.com/ | 跨域 | 子域名不同(www/blog) |

| http://www.test.com:8080/ | http://www.test.com:7001/ | 跨域 | 端口号不同(8080/7001) |

在resources中创建templates文件夹,在编写index页面

xxxxxxxxxx<!DOCTYPE html><html lang="en"><head> <meta charset="UTF-8"> <title>Title</title></head><body>

</body><script src="http://libs.baidu.com/jquery/2.0.0/jquery.min.js"></script><script> $.get("http://www.it.com/order/index",function(data,status){ alert("Data: " + data ); });</script></html>问题出现

CORS使得浏览器在向目的域发起请求之前先发起一个OPTIONS方式的请求到目的域获取目的域的信息,比如获取目的域允许什么域来请求的信息。

1.当一个请求url的____之间任意一个与当前页面url不同即为跨域。

A 协议、域名

B 协议、端口

C 协议、域名、请求类型

D 协议、域名、端口

2.最常用解决跨域的手段是____。

A CORS

B COS

C COR

D 以上都是错误

1=>D 2=>A

春运,一项全人类历史上最大规模的迁移活动,抢火车票一直是每年跨年以后的热点话题。

key-rate-limit插件实现了基于特定键值实现限流,键值来源可以是 URL 参数、HTTP 请求头

| 名称 | 数据类型 | 填写要求 | 默认值 | 描述 |

|---|---|---|---|---|

| limit_by_header | string | 选填,limit_by_header,limit_by_param 中选填一项 | - | 配置获取限流键值的来源 http 请求头名称 |

| limit_by_param | string | 选填,limit_by_header,limit_by_param 中选填一项 | - | 配置获取限流键值的来源 URL 参数名称 |

| limit_keys | array of object | 必填 | - | 配置匹配键值后的限流次数 |

limit_keys中每一项的配置字段说明

| 名称 | 数据类型 | 填写要求 | 默认值 | 描述 |

|---|---|---|---|---|

| key | string | 必填 | - | 匹配的键值 |

| query_per_second | number | 选填,query_per_second,query_per_minute,query_per_hour,query_per_day 中选填一项 | - | 允许每秒请求次数 |

| query_per_minute | number | 选填,query_per_second,query_per_minute,query_per_hour,query_per_day 中选填一项 | - | 允许每分钟请求次数 |

| query_per_hour | number | 选填,query_per_second,query_per_minute,query_per_hour,query_per_day 中选填一项 | - | 允许每小时请求次数 |

| query_per_day | number | 选填,query_per_second,query_per_minute,query_per_hour,query_per_day 中选填一项 | - | 允许每天请求次数 |

1、识别请求参数 apikey,进行区别限流

xxxxxxxxxxlimit_by_param: apikeylimit_keys:- key: 9a342114-ba8a-11ec-b1bf-00163e1250b5 query_per_second: 10- key: a6a6d7f2-ba8a-11ec-bec2-00163e1250b5 query_per_minute: 1002、识别请求头 x-ca-key,进行区别限流

xxxxxxxxxxlimit_by_header: x-ca-keylimit_keys:- key: 102234 query_per_second: 10- key: 308239 query_per_hour: 10

bot-detect插件可以用于识别并阻止互联网爬虫对站点资源的爬取

| 名称 | 数据类型 | 填写要求 | 默认值 | 描述 |

|---|---|---|---|---|

| allow | array of string | 选填 | - | 配置匹配 User-Agent 请求头的正则表达式,匹配命中时将允许其访问 |

| deny | array of string | 选填 | - | 配置匹配 User-Agent 请求头的正则表达式,匹配命中时将屏蔽请求 |

| blocked_code | number | 选填 | 403 | 配置请求被屏蔽时返回的 HTTP 状态码 |

| blocked_message | string | 选填 | - | 配置请求被屏蔽时返回的 HTTP 应答 Body |

注意:

allow和deny字段可以均不配置,则执行默认的爬虫判断逻辑,通过配置allow字段可以将原本命中默认爬虫判断逻辑的请求放行,通过配置deny字段可以增加额外的爬虫判断逻辑。

默认的爬虫判断正则表达式集合如下:

xxxxxxxxxx# Bots General matcher 'name/0.0'(?:\/[A-Za-z0-9\.]+|) {0,5}([A-Za-z0-9 \-_\!\[\]:]{0,50}(?:[Aa]rchiver|[Ii]ndexer|[Ss]craper|[Bb]ot|[Ss]pider|[Cc]rawl[a-z]{0,50}))[/ ](\d+)(?:\.(\d+)(?:\.(\d+)|)|)# Bots General matcher 'name 0.0'(?:\/[A-Za-z0-9\.]+|) {0,5}([A-Za-z0-9 \-_\!\[\]:]{0,50}(?:[Aa]rchiver|[Ii]ndexer|[Ss]craper|[Bb]ot|[Ss]pider|[Cc]rawl[a-z]{0,50})) (\d+)(?:\.(\d+)(?:\.(\d+)|)|)# Bots containing spider|scrape|bot(but not CUBOT)|Crawl((?:[A-z0-9]{1,50}|[A-z\-]{1,50} ?|)(?: the |)(?:[Ss][Pp][Ii][Dd][Ee][Rr]|[Ss]crape|[Cc][Rr][Aa][Ww][Ll])[A-z0-9]{0,50})(?:(?:[ /]| v)(\d+)(?:\.(\d+)|)(?:\.(\d+)|)|)# Bots Pattern '/name-0.0'/((?:Ant-)?Nutch|[A-z]+[Bb]ot|[A-z]+[Ss]pider|Axtaris|fetchurl|Isara|ShopSalad|Tailsweep)[ \-](\d+)(?:\.(\d+)(?:\.(\d+))?)?# Bots Pattern 'name/0.0'\b(008|Altresium|Argus|BaiduMobaider|BoardReader|DNSGroup|DataparkSearch|EDI|Goodzer|Grub|INGRID|Infohelfer|LinkedInBot|LOOQ|Nutch|OgScrper|PathDefender|Peew|PostPost|Steeler|Twitterbot|VSE|WebCrunch|WebZIP|Y!J-BR[A-Z]|YahooSeeker|envolk|sproose|wminer)/(\d+)(?:\.(\d+)|)(?:\.(\d+)|)# More bots(CSimpleSpider|Cityreview Robot|CrawlDaddy|CrawlFire|Finderbots|Index crawler|Job Roboter|KiwiStatus Spider|Lijit Crawler|QuerySeekerSpider|ScollSpider|Trends Crawler|USyd-NLP-Spider|SiteCat Webbot|BotName\/\$BotVersion|123metaspider-Bot|1470\.net crawler|50\.nu|8bo Crawler Bot|Aboundex|Accoona-[A-z]{1,30}-Agent|AdsBot-Google(?:-[a-z]{1,30}|)|altavista|AppEngine-Google|archive.{0,30}\.org_bot|archiver|Ask Jeeves|[Bb]ai[Dd]u[Ss]pider(?:-[A-Za-z]{1,30})(?:-[A-Za-z]{1,30}|)|bingbot|BingPreview|blitzbot|BlogBridge|Bloglovin|BoardReader Blog Indexer|BoardReader Favicon Fetcher|boitho.com-dc|BotSeer|BUbiNG|\b\w{0,30}favicon\w{0,30}\b|\bYeti(?:-[a-z]{1,30}|)|Catchpoint(?: bot|)|[Cc]harlotte|Checklinks|clumboot|Comodo HTTP\(S\) Crawler|Comodo-Webinspector-Crawler|ConveraCrawler|CRAWL-E|CrawlConvera|Daumoa(?:-feedfetcher|)|Feed Seeker Bot|Feedbin|findlinks|Flamingo_SearchEngine|FollowSite Bot|furlbot|Genieo|gigabot|GomezAgent|gonzo1|(?:[a-zA-Z]{1,30}-|)Googlebot(?:-[a-zA-Z]{1,30}|)|Google SketchUp|grub-client|gsa-crawler|heritrix|HiddenMarket|holmes|HooWWWer|htdig|ia_archiver|ICC-Crawler|Icarus6j|ichiro(?:/mobile|)|IconSurf|IlTrovatore(?:-Setaccio|)|InfuzApp|Innovazion Crawler|InternetArchive|IP2[a-z]{1,30}Bot|jbot\b|KaloogaBot|Kraken|Kurzor|larbin|LEIA|LesnikBot|Linguee Bot|LinkAider|LinkedInBot|Lite Bot|Llaut|lycos|Mail\.RU_Bot|masscan|masidani_bot|Mediapartners-Google|Microsoft .{0,30} Bot|mogimogi|mozDex|MJ12bot|msnbot(?:-media {0,2}|)|msrbot|Mtps Feed Aggregation System|netresearch|Netvibes|NewsGator[^/]{0,30}|^NING|Nutch[^/]{0,30}|Nymesis|ObjectsSearch|OgScrper|Orbiter|OOZBOT|PagePeeker|PagesInventory|PaxleFramework|Peeplo Screenshot Bot|PlantyNet_WebRobot|Pompos|Qwantify|Read%20Later|Reaper|RedCarpet|Retreiver|Riddler|Rival IQ|scooter|Scrapy|Scrubby|searchsight|seekbot|semanticdiscovery|SemrushBot|Simpy|SimplePie|SEOstats|SimpleRSS|SiteCon|Slackbot-LinkExpanding|Slack-ImgProxy|Slurp|snappy|Speedy Spider|Squrl Java|Stringer|TheUsefulbot|ThumbShotsBot|Thumbshots\.ru|Tiny Tiny RSS|Twitterbot|WhatsApp|URL2PNG|Vagabondo|VoilaBot|^vortex|Votay bot|^voyager|WASALive.Bot|Web-sniffer|WebThumb|WeSEE:[A-z]{1,30}|WhatWeb|WIRE|WordPress|Wotbox|www\.almaden\.ibm\.com|Xenu(?:.s|) Link Sleuth|Xerka [A-z]{1,30}Bot|yacy(?:bot|)|YahooSeeker|Yahoo! Slurp|Yandex\w{1,30}|YodaoBot(?:-[A-z]{1,30}|)|YottaaMonitor|Yowedo|^Zao|^Zao-Crawler|ZeBot_www\.ze\.bz|ZooShot|ZyBorg)(?:[ /]v?(\d+)(?:\.(\d+)(?:\.(\d+)|)|)|)

放行原本命中爬虫规则的请求

xxxxxxxxxxallow:- ".*Go-http-client.*"若不作该配置,默认的 Golang 网络库请求会被视做爬虫,被禁止访问

增加爬虫判断

xxxxxxxxxxdeny:- "spd-tools.*"根据该配置,下列请求将被禁止访问:

xxxxxxxxxxcurl http://example.com -H 'User-Agent: spd-tools/1.1'curl http://exmaple.com -H 'User-Agent: spd-tools'