目录

目录JAVA全系列 教程

3762个小节阅读:7094.2k

目录

C语言快速入门

JAVA全系列 教程

面向对象的程序设计语言

Python全系列 教程

Python3.x版本,未来主流的版本

人工智能 教程

顺势而为,AI创新未来

大厂算法 教程

算法,程序员自我提升必经之路

C++ 教程

一门通用计算机编程语言

微服务 教程

目前业界流行的框架组合

web前端全系列 教程

通向WEB技术世界的钥匙

大数据全系列 教程

站在云端操控万千数据

AIGC全能工具班

A A

White Night

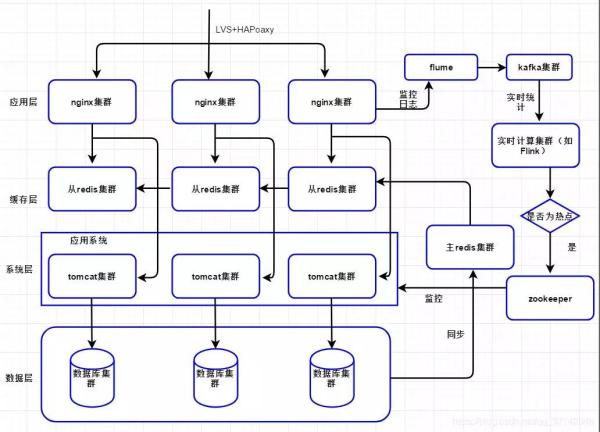

所谓多级缓存,即在整个系统架构的不同系统层级进行数据缓存,以提升访问效率,这也是应用最广的方案之一。

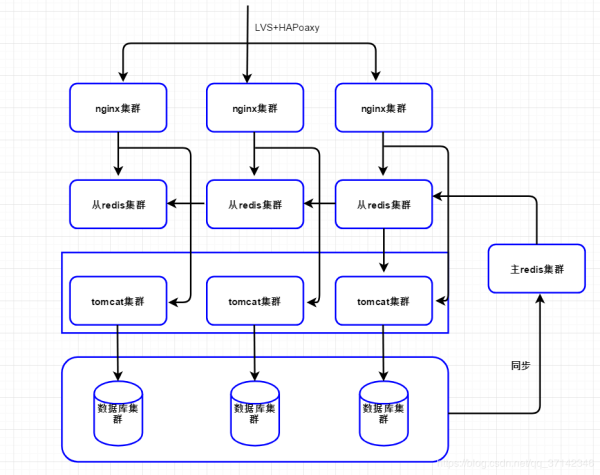

整个多级缓存系统被分为三层,应用层nginx缓存,分布式redis缓存集群,tomcat堆内缓存。

接下来,我们再来介绍下,在 OpenResty 中被普遍使用的缓存封装:

lua-resty-mlcache。它使用 shared dict 和 lua-resty-lrucache ,实现了多层缓存机制。我们下面就通过两段代码示例,来看看这个库如何使用:

xxxxxxxxxxlocal mlcache = require "resty.mlcache"local cache, err = mlcache.new("cache_name", "cache_dict", {lru_size = 500, -- size of the L1 (Lua VM) cachettl = 3600, -- 1h ttl for hitsneg_ttl = 30, -- 30s ttl for misses})if not cache thenerror("failed to create mlcache: " .. err)end

请求处理时的逻辑代码:

xxxxxxxxxxlocal function fetch_user(id)return db:query_user(id)endlocal id = 123local user , err = cache:get(id , nil , fetch_user , id)if err thenngx.log(ngx.ERR , "failed to fetch user: ", err)returnendif user thenprint(user.id) -- 123end

你可以看到,这里已经把多层缓存都给隐藏了,你只需要使用 mlcache 的对象去获取缓存,并同时设置好缓存失效后的回调函数就可以了。这背后复杂的逻辑,就可以被完全地隐藏了。

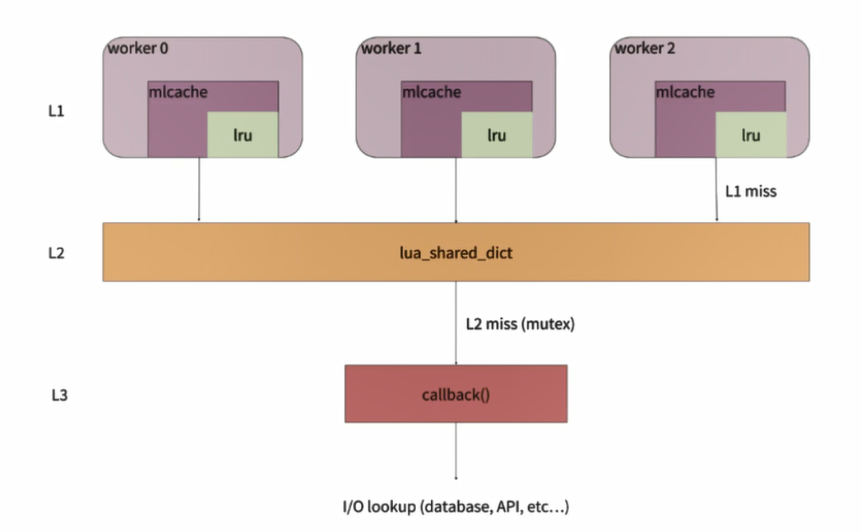

从图中你可以看到,mlcache 把数据分为了三层,即 L1、L2 和 L3。

L1 缓存就是 lua-resty-lrucache。每一个 worker 中都有自己独立的一份,有 N 个 worker,就会有 N 份数据,自然也就存在数据冗余。由于在单 worker 内操作 lrucache 不会触发锁,所以它的性能更高,适合作为第一级缓存。

L2 缓存是 shared dict。所有的 worker 共用一份缓存数据,在 L1 缓存没有命中的情况下,就会来查询 L2 缓存。ngx.shared.DICT 提供的 API,使用了自旋锁来保证操作的原子性,所以这里我们并不用担心竞争的问题;

L3 则是在 L2 缓存也没有命中的情况下,需要执行回调函数去外部数据库等数据源查询后,再缓存到 L2 中。在这里,为了避免缓存风暴,它会使用 lua-resty-lock ,来保证只有一个 worker 去数据源获取数据。